共计 3081 个字符,预计需要花费 8 分钟才能阅读完成。

前言

OpenAI 直播第三天,Sora 正式登场

本次发布会延续了「短剧」的快节奏风格,全程 20 分钟左右,由 CEO Sam Altman、Sora 负责人 Bill Peebles 等人主持

官网地址:sora.com

有意思的是,由于 Sora 热度太高,短期内大批用户涌入网站,导致官网一度崩溃,现在已经暂停注册登录服务

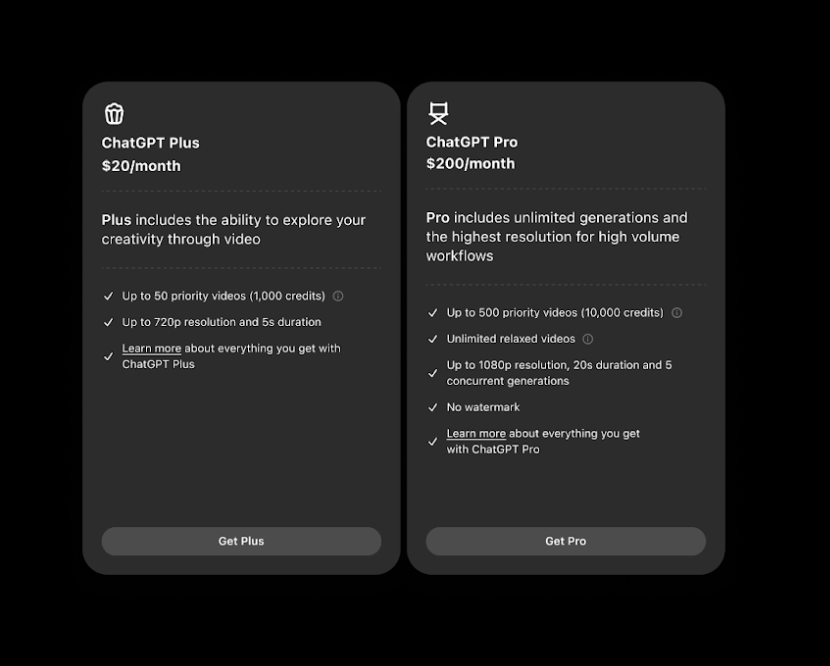

不过这次 Sora 的生成服务只要订阅 OpenAI Plus 或者 Pro 就可以体验,不需要额外付费,要订阅 Plus 可以查看往期文章: 国内升级 ChatGPT-4.0 超详细教程(2024 最新)

Sora 功能解析

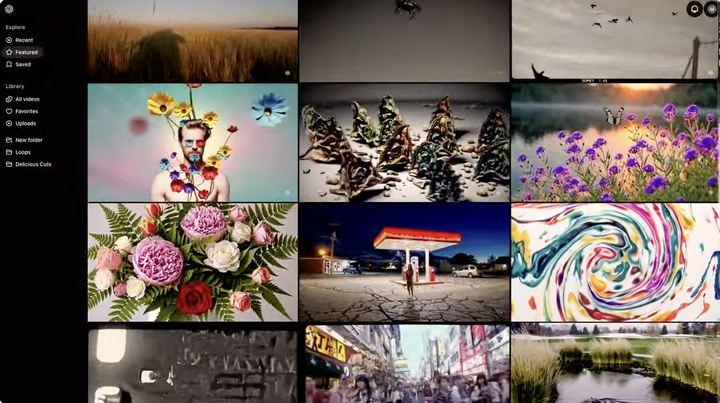

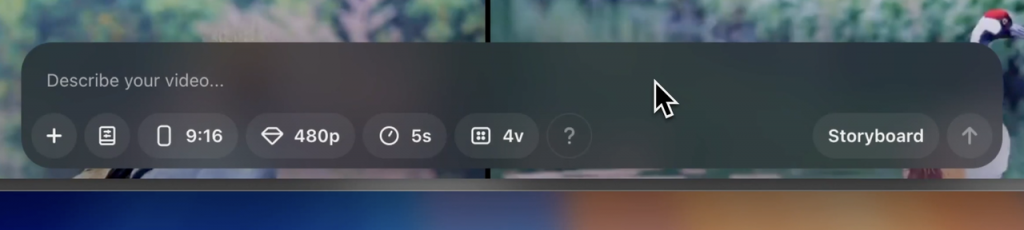

与 Midjourney 的界面类似,Sora 也有单独的用户界面,用户可以整理和浏览生成的视频,且能查看其他用户的提示词和精选内容

在「Library」中,用户可以保存自己喜欢或有用的提示词,以便未来使用。并且保存的提示词可以按需查看或修改,对于经常需要产出相似风格内容的创作者来说,这简直就是效率神器

不过真正让人眼前一亮的是 Sora 在 视频编辑 方面的创新。

它的 Remix 功能堪称革命性突破——只需要用自然语言描述想要的改动,就像跟助手对话一样简单。而且通过直观的「strength(强度)」强度调节滑块,可以精确控制想要的变化程度,完全不需要专业的后期技能。

Re-cut 功能则能智能识别最佳画面,并能突破原有画面的限制,支持向任意方向延伸场景。

Storyboard(故事板)则类似于视频编辑器,可以将多个提示词串联在一起,生成一个更长的视频,轻松处理复杂的多分镜场景。

结合 Loop 和 Blend 功能,可以轻松制作出完美无缝循环的画面,不同片段之间的过渡自然流畅,配合 Style presets 预设功能,可以轻松掌控整个视频的风格调性

Sora 不仅支持 5-20 秒的输出时长,并且完全适配当下最常用的视频比例,无论是方形的 1:1 还是竖屏的 9:16,都能完美驾驭。相比早期版本,现在的生成速度有了显著提升。

不过之前说的 1 分钟高清无码的大片并没有实现,也算是一个遗憾,等待下次更新实现

Sora 积分政策

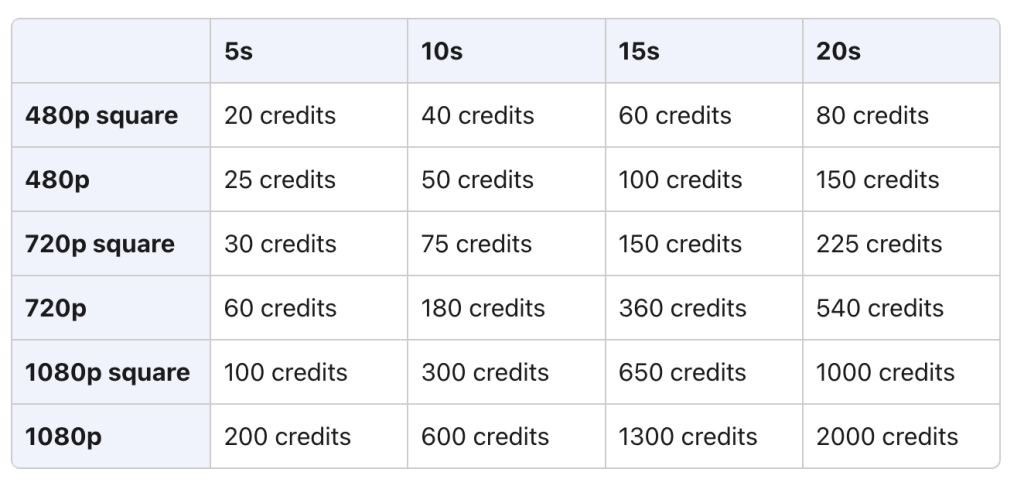

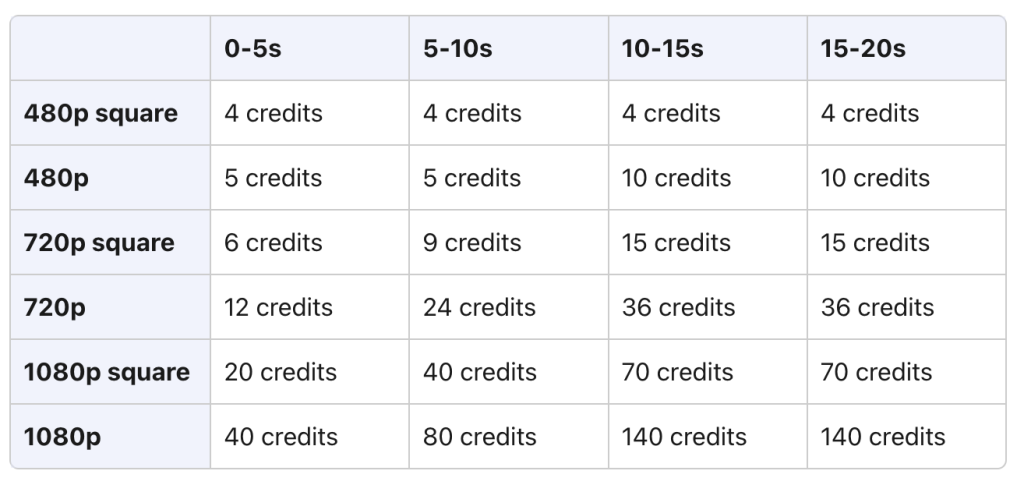

OpenAI 这次的定价策略采用灵活的积分制,具体消耗会根据选择的分辨率和视频时长来计算

如果你已经是 ChatGPT Plus 或 Pro 会员无需额外费用就能使用

比如生成一个 480p、5s 的视频就需要 25 个积分,但生成 480p、20s 的视频则需要 150 个积分。

特别注意,当使用那些高级功能比如 Re-cut、Remix、Blend 或 Loop 时,如果最终作品超过了 5 秒,系统会额外扣积分。说白了就是:” 多玩多付 ”。所以开始创作前,最好先规划好视频时长,算清楚需要的积分,这样才不会中途因为积分不够而被打断创作 flow

视频生成权益:

20 美元 / 月的 ChatGPT Plus 用户:

- 最多 50 个优先视频(1000 个积分)

- 分辨率高达 720p,时长为 5 秒

200 美元 / 月的 ChatGPT Pro 用户:

- 最多 500 个优先视频(10000 个积分)

- 无限 relaxed 视频

- 分辨率高达 1080p,持续时间为 20 秒,可并发生成 5 个

- 下载无水印

OpenAI 还在为不同用户的使用场景来制定更个性化的收费模式,预计会在明年初推出。

同时,Sora 暂不支持 ChatGPT Team、Enterprise 和 Edu 版本,同时也不向 18 岁以下用户开放。现阶段,虽然 Sora 基本上在所有能用 ChatGPT 的地方都能访问,但英国、瑞士和欧盟等地区除外。

Sora 实测

知名博主 Marques Brownlee 提前一周就用上了 Sora,并在 YouTube 上分享了他的使用体验

他指出这款产品仍存在一些「局限性」。

在物理模拟方面,模型对物体运动的理解不够深入,会出现动作不自然、物体突然消失等问题。特别是在处理带有腿部运动的对象时,经常出现前后腿位置混乱的情况,导致动作看起来不自然。

又或者,同一个视频里,有些画面像是开了 0.5 倍速播放,而其他部分却是正常速度,这种节奏的忽快忽慢看着特别不自在。这也再次印证了一个事实:AI 在理解现实世界的物理规律上还是个 ” 学生 ”。同样 Sora 还是没能解决老毛病,缺乏对物理世界规律的理解。

另外,Sora 没能解决文字生成的问题,导致经常出现文字混乱的现象,而剪辑风格、文字滚动条的运动、新闻主播风格的生成则格外逼真。这种强弱分明的表现,表面 Sora 有些领域已经炉火纯青,有些地方却还在跌跌撞撞。

不过,Sora 也有很多擅长的场景。

在风景镜头处理方面表现出色,能生成媲美专业素材的无人机航拍镜头

性能方面,基础场景下还是很给力的,生成一个 5 秒的 360p 小视频,通常 20 秒就能搞定

不过,当涉及 1080p 或复杂提示词时,生成时间可能会延长到几分钟,并且随着如今大批用户的涌入,生成速度明显慢了很多

Sora 带来的扩展思考

OpenAI 对 Sora 的定位不是简单地把它看作一个视频生成工具,而是将其视为通往通用人工智能(AGI)的重要一步。

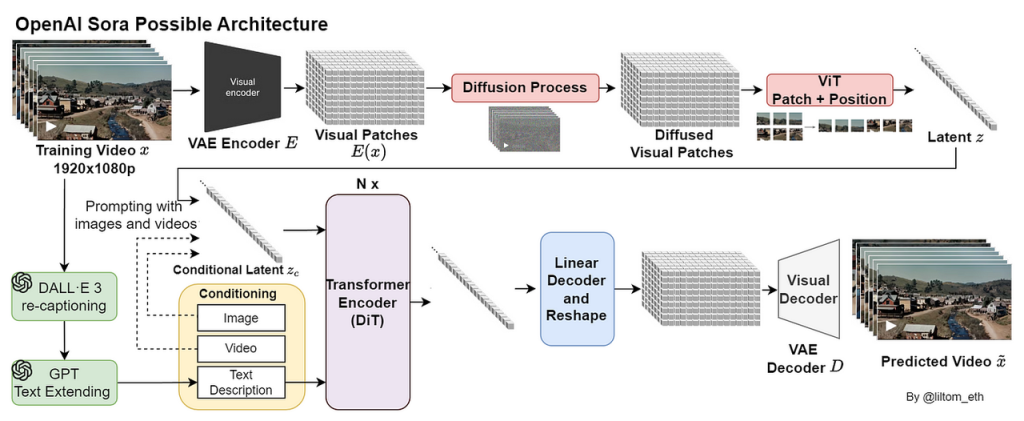

让我用通俗的方式解释一下 Sora 的工作原理:比如你在看一幅印象派油画,一开始全是模糊的色块和噪点。Sora 就像一位艺术修复师,能逐步清除这些 ” 噪点 ”,最终呈现出完整清晰的视频画面。并且它能同时处理多个画面帧,就像在是在玩 ” 记忆连连看 ”——即使画面中的物体暂时看不见了,它也能确保这个物体再次出现时保持一致性,不会突然变成另一个东西。

技术架构方面,Sora 采用了和 ChatGPT 相同的 ” 底层架构 ”——Transformer。这就像是它们共用同一个 ” 大脑结构 ”,只是被训练来完成不同的任务。

Sora 继承了 DALL·E 3 的标注技术,为视觉训练数据生成高度描述性的标签。因此,模型能够更准确地根据用户的文本指令生成视频内容。

并且 Sora 的能力可不止于从文字生成视频。它还有两个特性:一是能将静态图片 ” 转化 ” 为动态视频,而且细节处理得相当到位;二是可以对现有视频进行 ” 修补 ”,比如填补缺失的画面帧

为了确保安全地部署 Sora,OpenAI 基于以往的安全经验对安全防护措施进行了强化。

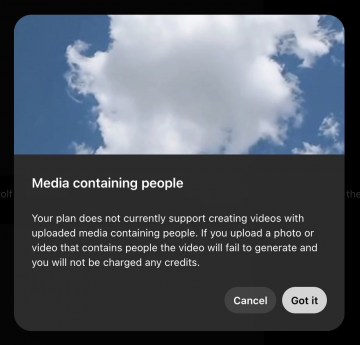

- 未经他人许可使用他人肖像,并禁止描绘真实未成年人;

- 创建非法内容或侵犯知识产权的内容;

- 禁止生成有害内容,例如未经同意的亲密影像、用于欺凌、骚扰或诽谤的内容,或旨在传播暴力、仇恨或使他人痛苦的内容;

- 创建并传播用于欺诈、诈骗或误导他人的内容。

所有 Sora 生成的视频都带有 C2PA 元数据,这些元数据能够标识视频的来源是 Sora,从而提高透明度,并可用于验证其来源。

还记得大半年前 Sora 刚亮相时,整个互联网都沸腾了。那时候,只要看到几个演示视频,我们就会激动地喊出「现实不存在了」这样的豪言壮语。但现在回头看,这种情绪似乎有点过于乐观了。

经历了国内外各种 AI 视频模型的轮番轰炸,我们的期待值早已水涨船高。现在的用户不再满足于简单的「能不能做」,而是更关注「做得有多好」。这种心态转变其实很正常,当技术从概念验证阶段迈向实用阶段,用户的要求自然也会随之提升。

好在 Sora 并没有停滞不前。通过与艺术家们的深度合作,他们在工作流程方面做出了令人印象深刻的突破。Re-cut、Remix、Storyboard 这些功能都不是花架子,而是实打实解决了创作痛点的工具。在我看来,Sora 最大的价值不在于它能做什么,而是让创作者能够从繁琐的技术细节中解放出来,把更多精力放在创意本身。

从「能用」到「好用」,再到「妙用」,Sora 的进化之路才刚刚开始。也许在未来的某一天,我们会发现,真正没有限制的,不是现实世界,而是人类的创造力。毕竟,当工具变得足够强大,唯一的边界就只剩下想象力了。